- 品牌

- Nvidia

- 型号

- H100

- 磁盘阵列

- Raid10

- CPU类型

- Intel Platinum 8558 48 核

- CPU主频

- 2.10

- 内存类型

- 64G

- 硬盘容量

- Samsung PM9A3 7.6TB NVMe *8

- 厂家

- SuperMicro

- 标配CPU个数

- 2个

- 最大CPU个数

- 4个

- 内存容量

- 64G*32

- GPU

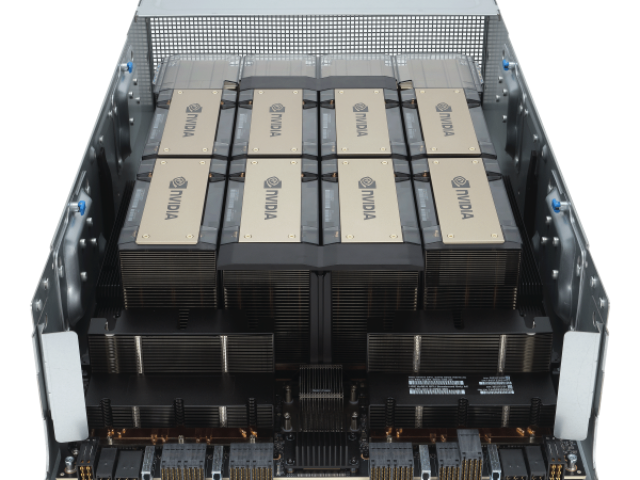

- 8 H100 80GB NVlink

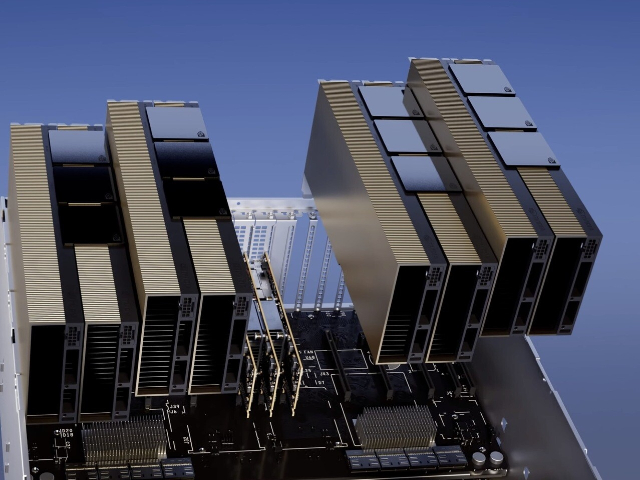

基于H100的系统和板卡H100SXM5GPU使用NVIDIA定制的SXM5板卡内置H100GPU和HMB3内存堆栈提供第四代NVLink和PCIeGen5连接提供高的应用性能这种配置非常适合在一个服务器和跨服务器的情况下将应用程序扩展到多个GPU上的客户,通过在HGXH100服务器板卡上配置4-GPU和8-GPU实现4-GPU配置:包括GPU之间的点对点NVLink连接,并在服务器中提供更高的CPU-GPU比率;8-GPU配置:包括NVSwitch,以提供SHARP在网络中的缩减和任意对GPU之间900GB/s的完整NVLink带宽。H100SXM5GPU还被用于功能强大的新型DGXH100服务器和DGXSuperPOD系统中。H100PCIeGen5GPU以有350W的热设计功耗(ThermalDesignPower,TDP),提供了H100SXM5GPU的全部能力该配置可选择性地使用NVLink桥以600GB/s的带宽连接多达两个GPU,接近PCIeGen5的5倍。H100PCIe非常适合主流加速服务器(使用标准的架构,提供更低服务器功耗),为同时扩展到1或2个GPU的应用提供了很好的性能,包括AIInference和一些HPC应用。在10个前列数据分析、AI和HPC应用程序的数据集中,单个H100PCIeGPU**地提供了H100SXM5GPU的65%的交付性能,同时消耗了50%的功耗。DGXH100andDGXSuperPODNVIDIADGXH100是一个通用的高性能人工智能系统。H100 GPU 的双精度浮点计算能力为 9.7 TFLOPS。上海H100GPU多少钱

使用张量维度和块坐标来定义数据传输,而不是每个元素寻址。TMA操作是异步的,利用了基于共享内存的异步屏障。TMA编程模型是单线程的,选择一个经线程中的单个线程发出一个异步TMA操作(cuda::memcpy_async)来复制一个张量,随后多个线程可以在一个cuda::barrier上等待完成数据传输。H100SM增加了硬件来加速这些异步屏障等待操作。TMA的一个主要***是它可以使线程自由地执行其他的工作。在Hopper上,TMA包揽一切。单个线程在启动TMA之前创建一个副本描述符,从那时起地址生成和数据移动在硬件中处理。TMA提供了一个简单得多的编程模型,因为它在复制张量的片段时承担了计算步幅、偏移量和边界计算的任务。异步事务屏障(“AsynchronousTransactionBarrier”)异步屏障:-将同步过程分为两步。①线程在生成其共享数据的一部分时发出"到达"的信号。这个"到达"是非阻塞的。因此线程可以自由地执行其他的工作。②终线程需要其他所有线程产生的数据。在这一点上,他们做一个"等待",直到每个线程都有"抵达"的信号。-***是允许提前到达的线程在等待时执行的工作。-等待的线程会在共享内存中的屏障对象上自转(spin)。HBMH100GPU一台多少钱H100 GPU 在云计算中的应用也非常多。

然后剩余的总共大约6个月。初创公司是否从OEM和经销商处购买?#没有。初创公司通常会去像甲骨文这样的大型云租用访问权限,或者像Lambda和CoreWeave这样的私有云,或者与OEM和数据中心合作的提供商,如FluidStack。初创公司何时构建自己的数据中心与进行托管?#对于构建数据中心,考虑因素是构建数据中心的时间,您是否具有硬件方面的人员和经验,以及它的资本支出是否昂贵。更容易租用和colo服务器。如果你想建立自己的DC,你必须在你所在的位置运行一条暗光纤线路来连接到互联网-每公里10万美元。大部分基础设施已经在互联网繁荣期间建成并支付。现在你可以租它,相当便宜–私有云执行官从租赁到拥有的范围是:按需云(使用云服务的纯租赁),保留云,colo(购买服务器,与提供商合作托管和管理服务器),自托管(自己购买和托管服务器)。大多数需要大量H100的初创公司将进行保留云或colo。大云如何比较?#人们认为,Oracle基础架构不如三大云可靠。作为交换,甲骨文会提供更多的技术支持帮助和时间。100%.一大堆不满意的客户,哈哈–私有云执行官我认为[甲骨文]有更好的网络–(不同)私有云高管一般来说,初创公司会选择提供支持、价格和容量的佳组合的人。

ITMALL.sale 是一家专业的 H100 GPU 代理商,以其质量的服务和高质量的产品赢得了广大客户的信赖。作为 NVIDIA 官方授权的代理商,ITMALL.sale 提供全系列的 H100 GPU 产品,确保客户能够获得、质量的图形处理器。无论是企业级应用还是个人用户,ITMALL.sale 都能够提供个性化的解决方案,满足不同客户的需求。ITMALL.sale 不仅提供产品销售,还为客户提供的技术支持和售后服务,确保客户在使用 H100 GPU 过程中无后顾之忧。此外,ITMALL.sale 还通过定期举办技术交流会和培训,帮助客户更好地了解和使用 H100 GPU 产品。ITMALL.sale 以其专业的技术团队和丰富的行业经验,为客户提供质量的服务,赢得了良好的市场口碑。H100 GPU 在科学计算领域表现出色。

可以在多个计算节点上实现多达256个GPU之间的GPU-to-GPU通信。与常规的NVLink(所有GPU共享一个共同的地址空间,请求直接使用GPU的物理地址进行路由)不同,NVLink网络引入了一个新的网络地址空间,由H100中新的地址转换硬件支持,以隔离所有GPU的地址空间和网络地址空间。这使得NVLink网络可以安全地扩展到更多的GPU上。由于NVLink网络端点不共享一个公共的内存地址空间,NVLink网络连接在整个系统中并不是自动建立的。相反,与其他网络接口(如IB交换机)类似,用户软件应根据需要显式地建立端点之间的连接。第三代NVSwitch包括驻留在节点内部和外部的交换机,用于连接服务器、集群和数据中心环境中的多个GPU。节点内部每一个新的第三代NVSwitch提供64个端口。NVLinklinks交换机的总吞吐率从上一代的Tbits/sec提高到Tbits/sec。还通过多播和NVIDIASHARP网内精简提供了集群操作的硬件加速。加速集群操作包括写广播(all_gather)、reduce_scatter、广播原子。组内多播和缩减能提供2倍的吞吐量增益,同时降低了小块大小的延迟。集群的NVSwitch加速降低了用于集群通信的SM的负载。新的NVLink交换系统新的NVLINK网络技术和新的第三代NVSwitch相结合。。对于开发者来说,H100 GPU 的稳定性和高能效为长时间的开发和测试提供了可靠保障.技嘉H100GPU多少钱一台

H100 GPU 优惠销售,机会难得。上海H100GPU多少钱

每个GPU实例在整个内存系统中都有单独的和孤立的路径--片上的交叉开关端口、L2缓存库、内存控制器和DRAM地址总线都是分配给单个实例的。这保证了单个用户的工作负载可以以可预测的吞吐量和延迟运行,具有相同的L2缓存分配和DRAM带宽,即使其他任务正在冲击自己的缓存或使其DRAM接口饱和。H100MIG改进:提供完全安全的、云原生的多租户、多用户的配置。Transformer引擎Transformer模型是当今从BERT到GPT-3使用的语言模型的支柱,需要巨大的计算资源。第四代NVLink和NVLink网络PCIe以其有限的带宽形成了一个瓶颈。为了构建强大的端到端计算平台,需要更快速、更可扩展的NVLink互连。NVLink是NVIDIA公司推出的高带宽、高能效、低延迟、无损的GPU-to-GPU互连。其中包括弹性特性,如链路级错误检测和数据包重放机制,以保证数据的成功传输。新的NVLink为多GPUIO和共享内存访问提供了900GB/s的总带宽,为PCIeGen5提供了7倍的带宽。A100GPU中的第三代NVLink在每个方向上使用4个差分对(4个通道)来创建单条链路,在每个方向上提供25GB/s的有效带宽,而第四代NVLink在每个方向上使用2个高速差分对来形成单条链路,在每个方向上也提供25GB/s的有效带宽。引入了新的NVLink网络互连。上海H100GPU多少钱

- 40GH100GPU多少钱一台 2024-10-30

- Qatar戴尔H100GPU 2024-10-30

- 超微H100GPU how much 2024-10-29

- TaiwanH100GPU discount 2024-10-29

- QatarH100GPU促销价 2024-10-29

- HPEH100GPU库存 2024-10-29

- xfusionH100GPU price 2024-10-29

- H100GPU总代 2024-10-29

- SupermicroH100GPU优惠 2024-10-29

- 香港H100GPU一台多少钱 2024-10-29

- NvdiaH100GPU 2024-10-28

- SupermicroH100GPU促销 2024-10-28