- 品牌

- Nvidia

- 型号

- H100

- 磁盘阵列

- Raid10

- CPU类型

- Intel Platinum 8558 48 核

- CPU主频

- 2.10

- 内存类型

- 64G

- 硬盘容量

- Samsung PM9A3 7.6TB NVMe *8

- 厂家

- SuperMicro

- 标配CPU个数

- 2个

- 最大CPU个数

- 4个

- 内存容量

- 64G*32

- GPU

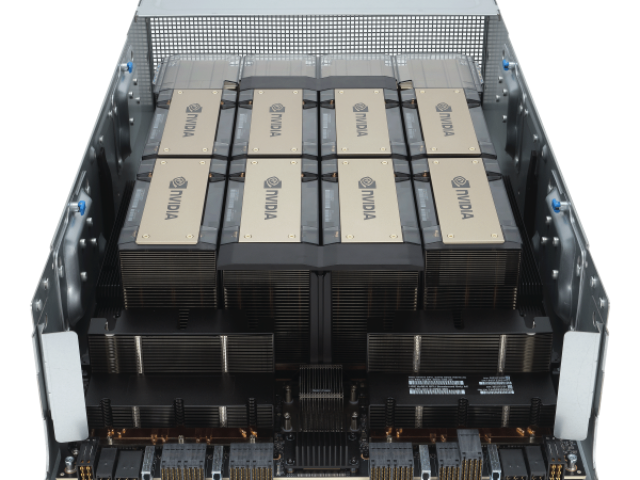

- 8 H100 80GB NVlink

我们将定期举办技术交流会和培训,帮助客户更好地了解和使用 H100 GPU 产品。通过与客户的面对面交流,ITMALL.sale 不仅能够分享新的技术和产品信息,还能够深入了解客户的需求和挑战。ITMALL.sale 的技术前辈会在交流会上详细讲解 H100 GPU 的使用方法和最佳实践,解答客户的技术问题,并提供实用的建议和解决方案,帮助客户充分发挥 H100 GPU 的性能,提升业务效率。ITMALL.sale 的技术交流会不仅是客户学习和提升的机会,也是客户与行业前辈交流和合作的平台,促进技术进步和创新发展。H100 GPU 优惠直降,数量有限。技嘉H100GPU "width:100%;text-align: center;">

大多数GPU用于什么用途?#对于使用私有云(CoreWeave、Lambda)的公司,或拥有数百或数千台H100的公司,几乎都是LLM和一些扩散模型工作。其中一些是对现有模型的微调,但大多数是您可能还不知道的从头开始构建新模型的新创业公司。他们正在签订为期3年、价值1000万至5000万美元的合同,使用几百到几千台GPU。对于使用带有少量GPU的按需H100的公司来说,其LLM相关使用率可能仍>50%。私有云现在开始受到企业的青睐,这些企业通常会选择默认的大型云提供商,但现在大家都退出了。大型人工智能实验室在推理还是训练方面受到更多限制?#取决于他们有多少产品吸引力!SamAltman表示,如果必须选择,OpenAI宁愿拥有更多的推理能力,但OpenAI在这两方面仍然受到限制。HBMH100GPU购买H100 GPU 适用于智能制造领域。

他们与来自大云(Azure,GoogleCloud,AWS)的一些人交谈,试图获得许多H100。他们发现他们无法从大云中获得大量分配,并且一些大云没有良好的网络设置。因此,他们与其他提供商(如CoreWeave,Oracle,Lambda,FluidStack)进行了交谈。如果他们想自己购买GPU并拥有它们,也许他们也会与OEM和Nvidia交谈。终,他们获得了大量的GPU。现在,他们试图获得产品市场契合度。如果不是很明显,这条途径就没有那么好了-请记住,OpenAI在更小的模型上获得了产品市场契合度,然后将它们扩大了规模。但是,现在要获得产品市场契合度,您必须比OpenAI的模型更适合用户的用例,因此首先,您将需要比OpenAI开始时更多的GPU。预计至少到100年底,H2023将短缺数百或数千次部署。到2023年底,情况将更加清晰,但就目前而言,短缺似乎也可能持续到2024年的某些时间。GPU供需之旅。大版本取得联系#作者:克莱·帕斯卡。问题和笔记可以通过电子邮件发送。新帖子:通过电子邮件接收有关新帖子的通知。帮助:看这里。自然的下一个问题-英伟达替代品呢?#自然的下一个问题是“好吧,竞争和替代方案呢?我正在探索硬件替代方案以及软件方法。提交我应该探索的东西作为此表格的替代方案。例如。

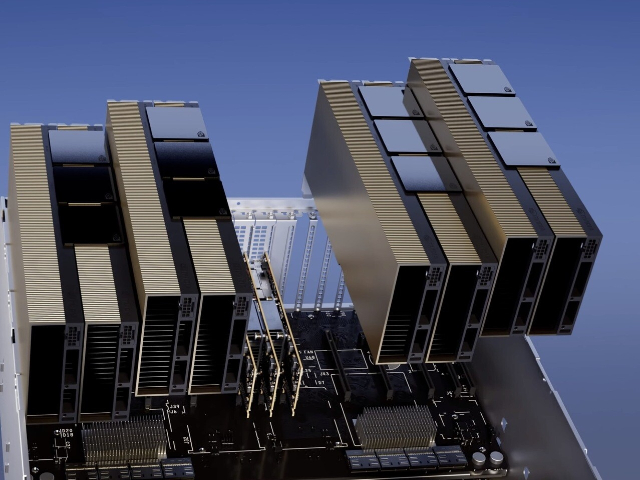

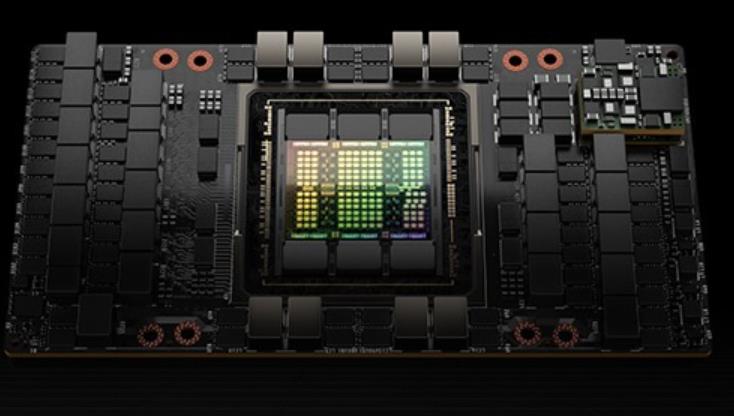

提供了1exaFLOP的FP8稀疏AI计算性能。同时支持无线带宽(InifiniBand,IB)和NVLINKSwitch网络选项。HGXH100通过NVLink和NVSwitch提供的高速互连,HGXH100将多个H100结合起来,使其能创建世界上强大的可扩展服务器。HGXH100可作为服务器构建模块,以集成底板的形式在4个或8个H100GPU配置中使用。H100CNXConvergedAcceleratorNVIDIAH100CNX将NVIDIAH100GPU的强大功能与NVIDIA®ConnectX-7SmartNIC的**组网能力相结合,可提供高达400Gb/s的带宽包括NVIDIAASAP2(加速交换和分组处理)等创新功能,以及用于TLS/IPsec/MACsec加密/的在线硬件加速。这种独特的架构为GPU驱动的I/O密集型工作负载提供了前所未有的性能,如在企业数据中心进行分布式AI训练,或在边缘进行5G信号处理等。H100GPU架构细节异步GPUH100扩展了A100在所有地址空间的全局共享异步传输,并增加了对张量内存访问模式的支持。它使应用程序能够构建端到端的异步管道,将数据移入和移出芯片,完全重叠和隐藏带有计算的数据移动。CUDA线程只需要少量的CUDA线程来管理H100的全部内存带宽其他大多数CUDA线程可以专注于通用计算,例如新一代TensorCores的预处理和后处理数据。扩展了层次结构。购买 H100 GPU 享受限时特价。

H100GPU架构细节异步GPUH100扩展了A100在所有地址空间的全局共享异步传输,并增加了对张量内存访问模式的支持。它使应用程序能够构建端到端的异步管道,将数据移入和移出芯片,完全重叠和隐藏带有计算的数据移动。CUDA线程只需要少量的CUDA线程来管理H100的全部内存带宽其他大多数CUDA线程可以专注于通用计算,例如新一代TensorCores的预处理和后处理数据。扩展了层次结构,增加了一个称为线程块集群(ThreadBlockCluster)的新模块,集群(Cluster)是一组线程块(ThreadBlock),保证线程可以被并发调度,从而实现跨多个SM的线程之间的**协作和数据共享。集群还能更有效地协同驱动异步单元,如张量内存***(TensorMemoryAccelerator)和张量NVIDIA的异步事务屏障(“AsynchronousTransactionBarrier”)使集群中的通用CUDA线程和片上***能够有效地同步,即使它们驻留在单独的SM上。所有这些新特性使得每个用户和应用程序都可以在任何时候充分利用它们的H100GPU的所有单元,使得H100成为迄今为止功能强大、可编程性强、能效高的GPU。组成多个GPU处理集群(GPUProcessingClusters,GPCs)TextureProcessingClusters(TPCs)流式多处理器(StreamingMultiprocessors。H100 GPU 提供 312 TFLOPS 的 Tensor Core 性能。北京H100GPU代理商

H100 GPU 提供高效的数据分析能力。技嘉H100GPU 第四代NVIDIANVLink在全归约操作上提供了3倍的带宽提升,在7倍PCIeGen5带宽下,为多GPUIO提供了900GB/sec的总带宽,比上一代NVLink增加了50%的总带宽。第三代NVSwitch技术包括驻留在节点内部和外部的交换机,用于连接服务器、集群和数据中心环境中的多个GPU。节点内部的每个NVSwitch提供64个第四代NVLink链路端口,以加速多GPU连接。交换机的总吞吐率从上一代的。新的第三代NVSwitch技术也为多播和NVIDIASHARP网络内精简的集群操作提供了硬件加速。新的NVLinkSwitch系统互连技术和新的基于第三代NVSwitch技术的第二级NVLink交换机引入地址空间隔离和保护,使得多达32个节点或256个GPU可以通过NVLink以2:1的锥形胖树拓扑连接。这些相连的节点能够提供TB/sec的全连接带宽,并且能够提供难以置信的一个exaFlop(百亿亿次浮点运算)的FP8稀疏AI计算。PCIeGen5提供了128GB/sec的总带宽(各个方向上为64GB/s),而Gen4PCIe提供了64GB/sec的总带宽(各个方向上为32GB/sec)。PCIeGen5使H100可以与性能高的x86CPU和SmartNICs/DPU(数据处理单元)接口。技嘉H100GPU

- 40GH100GPU多少钱一台 2024-10-30

- Qatar戴尔H100GPU 2024-10-30

- 超微H100GPU how much 2024-10-29

- TaiwanH100GPU discount 2024-10-29

- QatarH100GPU促销价 2024-10-29

- HPEH100GPU库存 2024-10-29

- xfusionH100GPU price 2024-10-29

- H100GPU总代 2024-10-29

- SupermicroH100GPU优惠 2024-10-29

- 香港H100GPU一台多少钱 2024-10-29

- NvdiaH100GPU 2024-10-28

- SupermicroH100GPU促销 2024-10-28